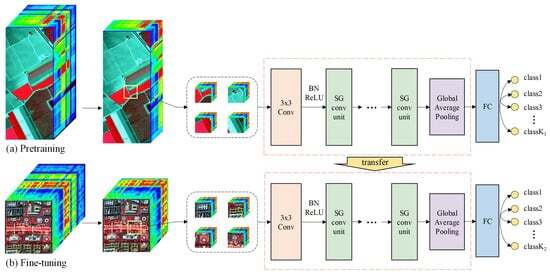

1. Review 지난 시간에는 Self-supervised Learning을 통해서 좋은 weight parameter를 얻고, Transfer Learning을 통해 본인이 가지고 있는 한정된 데이터셋과 할당된 task에 활용해 더 좋은 성능을 얻는 것이 목표였습니다. 2. transformer 트랜스포머는 추후에 조금 더 자세히 기술할 생각입니다. 워낙 블로그에 좋은 글이 많기 때문입니다. 2017년 구글에서 'Attention is all you need' 논문에서 아키텍처를 제안하며 rnn 기반의 seq to seq를 대체하였습니다. 즉, 어텐션만을 활용하여 더 뛰어난 아키텍처를 구성하였고, 이것이 자연스럽게 유행하면서 이를 PLM에 활용하여 유행하게 되었습니다. 이제는 NLP뿐만 아닌 다른 분..

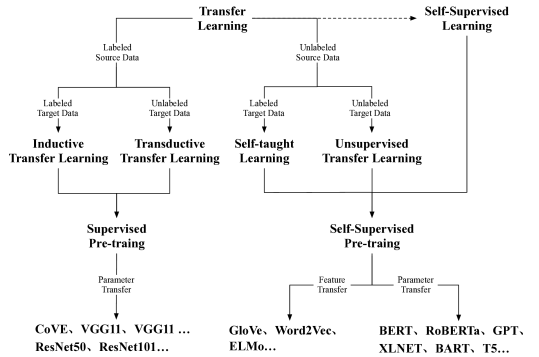

1. Motivations 처음에 전이학습이 나온 분야는 비전입니다. 데이터가 다르더라도 이미지를 활용한 공통된 Feature들이 존재할 것이라고 접근합니다. 꽃은 잎 모양, 길이가 비슷하나 조금씩 다 차이가 있습니다. 최소한의 공통적인 Feature를 활용하겠다는 사상에서 출발을 합니다. 2. Common Feature in NLP NLP에서는 공통적인 Feature들을 어떻게 뽑을 수 있을까요? I love to go to market. I would like to go home. You have to go to school. .... Corpus에 위와 같은 쉬운 표현들을 보면 semantic, syntactic 한 요소들이 사람이 보기에 쉽게 보일 수 있습니다. I wish to precariou..

1. comparison of Supervised vs. Unsupervised Learning Supervised Learning은 머신러닝 공부할 때 가장 제일 처음 나오는 부류의 학습방법입니다. label y와 data input의 관계를 학습합니다. 반면 Unsupervised Learning은 label y가 존재하지 않고 data x 분포 자체를 학습하거나 x의 feature를 학습하여 활용합니다. 2. Supervised learning 많은 데이터에 사람이 직접 label을 답니다. 이를 통해 입력 x와 output y사이의 관계를 학습합니다. Data y에 label을 다는 것이 인형에 눈알을 다는 것으로 행위가 유사하다고 빗대는데, 실제로 label을 다는 것은 정말 고되고 힘듭니다. ..